Depuis quelques temps, des techniques d’usurpation d’identité basées sur les deepfakes ont été mise à jour. Principalement utilisée pour passer des entretiens professionnels en ligne, cette technique consiste à recourir à une Intelligence artificielle (I.A) pour recréer synthétiquement du contenu audiovisuel d’êtres humains.

Pour lutter contre ces nouvelles formes d’escroqueries, les chercheurs en sécurité ont trouvé un moyen simple pour repérer si vous êtes face à un deepfake : il suffit de demander à votre interlocuteur de tourner son visage sur le côté.

Des entretiens d’embauche truqués

Au mois de juin dernier, le FBI indiquait que certaines personnes, principalement aux USA, recouraient aux deepfakes lors des entretiens d’embauche. Une tendance qui s’est progressivement installée depuis la pandémie de COVID 19 avec la généralisation du télétravail.

Cependant, le recours à cette fraude a surtout été observé au niveau des recruteurs du personnel informatique et technologique. Le FBI recommandait notamment au participants dans une vidéoconférence de débusquer les intrus en observant certains comportement comme la toux, les éternuements ou d’autres bruits naturels pour savoir si on était en face d’un être humain ou d’une réplique artificielle de la personne concernée.

Très peu de données de profil

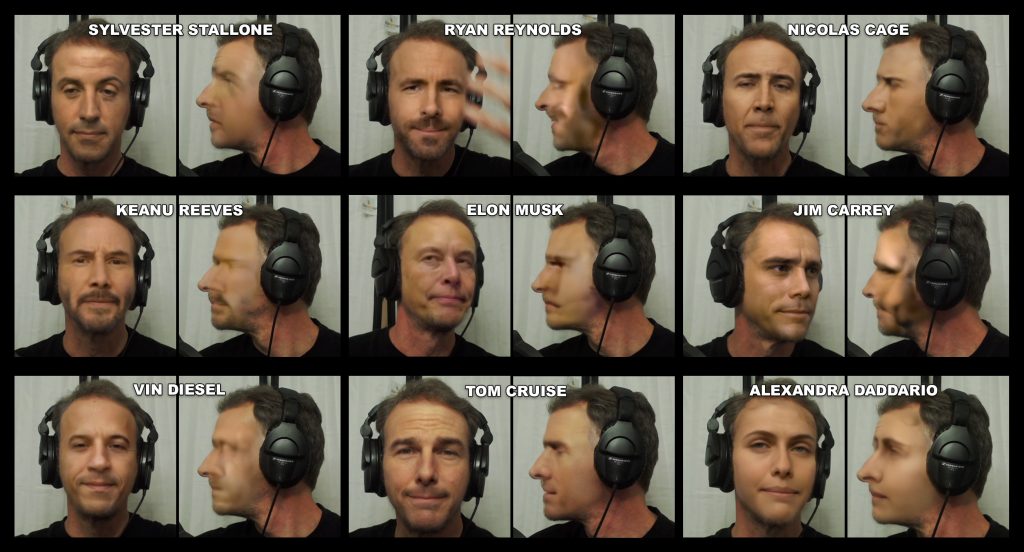

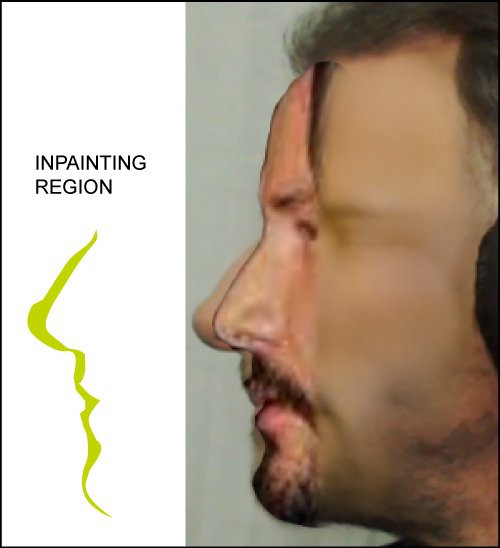

Dans un article publié par Metaphysic.ai, on apprend que la plupart des deepfakes échouent lorsque l’inclinaison du visage atteint 90°. Les algorithmes sont en fait généralement entrainés avec des visages de face, pas de profil. L’absence de données de profil de bonne qualité et en quantité suffisante oblige les machines à inventer des modèles de visage qui ne sont pas du tout convainquant.

Une fois que la personne tourne le visage, les algorithmes n’ont accès qu’à une partie des points de repère pour dessiner le visage, d’où l’échec.

Le journaliste Martin Anderson indique également que les principales faiblesses pour recréer un visage de profil sont les limites de la technologie utilisée pour entrainer les I.A jusqu’ici. En effet, ce sont des algorithmes d’alignement basé sur la 2D qui sont utilisés.

Le manque de données de profil est récurant pour la plupart des personnes, à l’exception des célébrités. Une pénurie des photos de profil pour les personnes ordinaires est donc à craindre étant donné que les gens n’en prennent pas eux-mêmes et que les photographes professionnels n’en voit pas la pertinence car manquant d’intérêt sur le plan émotionnel.

90% des systèmes biométriques KYC vulnérables

En mai, l’entreprise Sensity, qui travaille sur la détection des deepfakes et la vérification d’identité, rapportait que 90% des systèmes de vérification biométriques utilisant la norme Know Your Customer (KYC) dans le secteur financier présentaient de graves vulnérabilités face au attaque de type « face swap » recourant au deepfake. Les tests consistant à regarder une caméra connecté sont donc facile à tromper par les deepfakes.

Dans la vidéo, on voit effectivement le deepfake tourner la tête de gauche à droite, même s’il n’atteint pas les 90°. Pourtant, le deepfake a passé ce test conventionnel avec succès.

Des doutes peuvent donc persister concernant l’efficacité de cette technique en attendant des tests beaucoup plus déterminant.

Alors comment repérer les deepfakes

Si vous suspectez que l’interlocuteur qui est en face de vous dans une visioconférence n’est pas authentique, vous avez plusieurs possibilités.

- Vous pouvez lui demander de tourner son visage pendant quelques seconde de la gauche vers la droite, comme on l’a vu plus haut.

- Mais vous pouvez aussi lui dire d’agiter ses mains devant son visage, ces mouvements perturbent les points de repères situés sur le visage à partir desquels l’algorithme génère un visage.